Le concept de noyau dans l’apprentissage automatique peut sembler déroutant au premier abord, mais il s’agit d’une idée fondamentale qui sous-tend de nombreux algorithmes puissants. Il existe des théorèmes mathématiques qui soutiennent le principe de fonctionnement de tous les systèmes d’automatisation qui constituent une grande partie de notre vie quotidienne.

Les noyaux de l’apprentissage automatique servent de pont entre les transformations linéaires et non linéaires. Ils permettent aux algorithmes de travailler avec des données qui ne présentent pas de séparabilité linéaire dans leur forme originale. Considérez les noyaux comme des fonctions mathématiques qui prennent en compte des points de données et génèrent leurs relations dans un espace de dimension supérieure. Cela permet aux algorithmes de découvrir des modèles complexes qui autrement seraient négligés.

Alors, comment pouvez-vous utiliser le noyau dans l’apprentissage automatique pour votre propre algorithme ? Quel type privilégier ? Qu’est-ce que ces choix changent dans votre algorithme d’apprentissage automatique ? Regardons de plus près.

Qu’est-ce qu’un noyau dans l’apprentissage automatique ?

À la base, un noyau est une fonction qui calcule la similarité entre deux points de données. Il quantifie à quel point ces points sont étroitement liés dans l’espace des fonctionnalités. En appliquant une fonction noyau, nous transformons implicitement les données dans un espace de dimension supérieure où elles pourraient devenir linéairement séparables, même si elles ne se trouvaient pas dans l’espace d’origine.

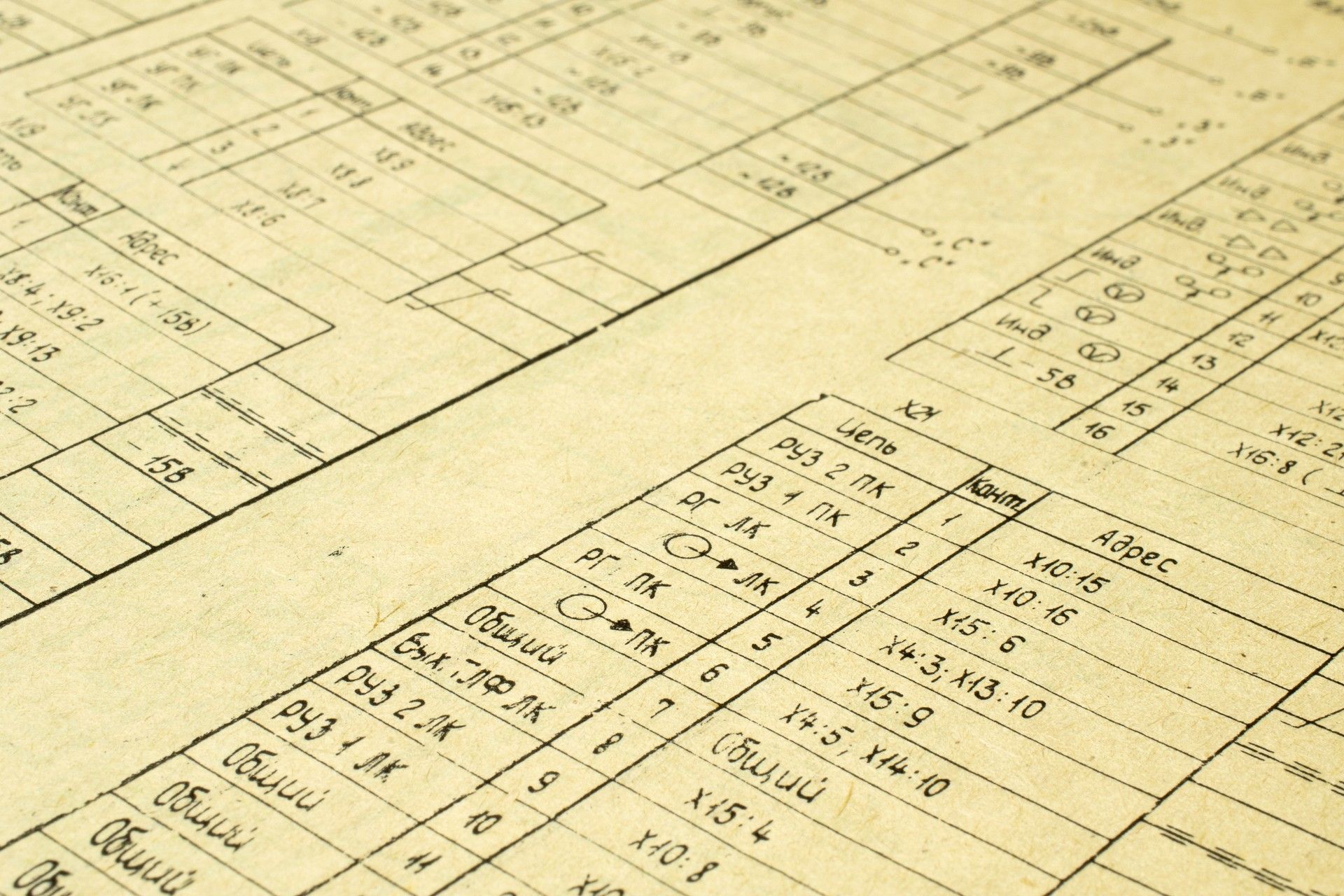

Il existe plusieurs types de noyaux, chacun adapté à des scénarios spécifiques :

- Noyau linéaire

- Noyau polynomial

- Noyau de la fonction de base radiale (RBF)

- Noyau sigmoïde

Noyau linéaire

Le noyau linéaire est la forme de noyau la plus simple en apprentissage automatique. Il fonctionne en calculant le produit scalaire entre deux points de données. Essentiellement, il mesure l’alignement de ces points dans l’espace des fonctionnalités. Cela peut paraître simple, mais ses implications sont puissantes.

Imaginez que vous ayez des points de données dans un espace bidimensionnel. Le noyau linéaire calcule le produit scalaire des valeurs caractéristiques de ces points. Si le résultat est élevé, cela signifie que les deux points ont des valeurs de caractéristiques similaires et appartiennent probablement à la même classe. Si le résultat est faible, cela suggère une dissemblance entre les points.

Le noyau linéaireLa magie de réside dans sa capacité à établir une limite de décision linéaire dans l’espace des fonctionnalités d’origine. C’est efficace lorsque vos données peuvent être séparées par une ligne droite. Cependant, lorsque les données ne sont pas linéairement séparables, c’est là que d’autres noyaux entrent en jeu.

Noyau polynomial

Le noyau polynomial de l’apprentissage automatique introduit une couche de complexité en appliquant des transformations polynomiales aux points de données. Il est conçu pour gérer les situations où une simple séparation linéaire ne suffit pas.

Imaginez que vous disposez d’un nuage de points de points de données qui ne peuvent pas être séparés par une ligne droite. L’application d’un noyau polynomial pourrait transformer ces points en un espace de dimension supérieure, introduisant une courbure. Cette transformation peut créer des limites de décision complexes qui s’adaptent mieux aux données.

Par exemple, dans un espace à deux dimensions, un noyau polynomial du degré 2 générerait de nouvelles fonctionnalités telles que x^2, y^2 et xy. Ces nouvelles fonctionnalités peuvent capturer des relations qui n’étaient pas évidentes dans l’espace d’origine. En conséquence, l’algorithme peut trouver une limite courbe qui sépare efficacement les classes.

Noyau de la fonction de base radiale (RBF)

Le noyau Radial Basis Function (RBF) dans l’apprentissage automatique est l’un des noyaux les plus utilisés dans la formation d’algorithmes. Il capitalise sur le concept de similarité en créant une mesure basée sur des distributions gaussiennes.

Imaginez des points de données dispersés dans l’espace. Le Noyau RBF calcule la similarité entre deux points en les traitant comme des centres de distributions gaussiennes. Si deux points sont proches, leurs distributions gaussiennes se chevaucheront de manière significative, indiquant une grande similarité. S’ils sont éloignés les uns des autres, le chevauchement sera minime.

Cette notion de similarité est puissante pour capturer des modèles complexes dans les données. Dans les cas où les points de données sont liés mais non linéairement séparables, l’utilisation du noyau RBF dans l’apprentissage automatique peut les transformer en un espace où ils deviennent plus distinctifs.

Noyau sigmoïde

Le noyau sigmoïde de l’apprentissage automatique remplit un objectif unique : il est utilisé pour transformer les données en un espace où la séparation linéaire devient possible. Ceci est particulièrement pratique lorsque vous traitez des données qui ne peuvent pas être séparées par une ligne droite dans leur forme originale.

Imaginez des points de données qui ne peuvent pas être divisés en classes à l’aide d’une limite linéaire. Le noyau sigmoïde vient à la rescousse en mappant ces points dans un espace de dimension supérieure à l’aide d’une fonction sigmoïde. Dans cet espace transformé, une frontière linéaire pourrait suffire à séparer efficacement les classes.

Le noyau sigmoïdeLa transformation de peut être considérée comme une déformation et une mise en forme des données de manière à simplifier la classification. Cependant, il est important de noter que même si l’utilisation d’un noyau sigmoïde dans l’apprentissage automatique peut être utile, il n’est peut-être pas aussi couramment utilisé que les noyaux linéaires, polynomiaux ou RBF.

Les noyaux sont au cœur de nombreux algorithmes d’apprentissage automatique, leur permettant de travailler avec des données non linéaires et complexes. Le noyau linéaire convient aux cas où une ligne droite peut séparer les classes. Le noyau polynomial ajoute de la complexité en introduisant des transformations polynomiales. Le noyau RBF mesure la similarité sur la base de distributions gaussiennes, excellant dans la capture de modèles complexes. Enfin, le noyau sigmoïde transforme les données pour permettre une séparation linéaire alors que cela n’était pas réalisable auparavant. En comprenant ces noyaux, les data scientists peuvent choisir le bon outil pour découvrir les modèles cachés dans les données, améliorant ainsi la précision et les performances de leurs modèles.

Comment utiliser les noyaux dans l’apprentissage automatique

Les noyaux, les héros méconnus de l’IA et l’apprentissage automatique, exercent leur magie transformatrice grâce à des algorithmes comme Machines à vecteurs de support (SVM). Cet article vous emmène dans un voyage à travers la danse complexe des noyaux et des SVM, révélant comment ils s’attaquent de manière collaborative à l’énigme de la séparation non linéaire des données.

La Fondation

Les machines à vecteurs de support, une catégorie d’algorithmes d’apprentissage supervisé, ont acquis une immense popularité pour leurs prouesses dans les tâches de classification et de régression. À la base, les SVM visent à trouver la limite de décision optimale qui maximise la marge entre les différentes classes dans les données.

Traditionnellement, les SVM sont utilisés dans un cadre linéaire, où une ligne droite peut séparer clairement les points de données en classes distinctes. Cependant, le monde réel n’est pas toujours aussi obligeant et les données présentent souvent des complexités qui défient une simple séparation linéaire.

Un héros sans cape pour votre algorithme

C’est là que les noyaux entrent en jeu, introduisant les SVM dans le domaine des données non linéaires. Les noyaux offrent aux SVM la possibilité de projeter les données dans un espace de dimension supérieure où les relations non linéaires deviennent plus évidentes.

La transformation accomplie par les noyaux étend les capacités des SVM au-delà des frontières linéaires, leur permettant de naviguer dans des paysages de données complexes.

Passons en revue le processus d’utilisation des noyaux avec les SVM pour exploiter tout leur potentiel.

Point de départ

Imaginez que vous travaillez avec des points de données sur un plan bidimensionnel. Dans un scénario linéairement séparable, une ligne droite peut effectivement diviser les données en différentes classes. Ici, un SVM linéaire standard suffit et aucun noyau n’est nécessaire.

Le dilemme

Cependant, toutes les données ne se prêtent pas à une séparation linéaire. Considérons un scénario dans lequel les points de données sont entrelacés, ce qui rend une limite linéaire inadéquate. C’est là que le noyau de l’apprentissage automatique intervient pour sauver la situation.

Un voyage transformateur

Vous disposez d’une variété de noyaux, chacun adapté à des situations spécifiques. Prenons l’exemple du noyau Radial Basis Function (RBF). Ce noyau calcule la similarité entre points de données basés sur des distributions gaussiennes.

En appliquant le noyau RBF, vous transformez les données en un espace de dimension supérieure où des relations auparavant cachées sont révélées.

Séparation non linéaire

Dans cet espace de dimension supérieure, les SVM peuvent désormais établir une frontière de décision linéaire qui sépare efficacement les classes. Ce qui est remarquable, c’est que cette limite linéaire dans l’espace transformé correspond à une limite non linéaire dans l’espace de données d’origine. C’est comme plier et façonner la réalité pour l’adapter à vos besoins.

Au-delà de la surface

Les grains apportent plus qu’une simple élégance visuelle à la table. Ils améliorent les SVM de plusieurs manières cruciales :

Gérer la complexité: Le noyau dans l’apprentissage automatique permet aux SVM de gérer des données qui défient la séparation linéaire. Ceci est inestimable dans les scénarios du monde réel où les données se conforment rarement à des structures simplistes.

Libérer des informations: En projetant des données dans des espaces de dimension supérieure, les noyaux peuvent dévoiler des relations et des modèles complexes qui étaient auparavant cachés. Cela conduit à des modèles plus précis et plus robustes.

Limites de décision flexibles: Le noyau de l’apprentissage automatique offre la flexibilité nécessaire pour créer des limites de décision complexes, s’adaptant aux nuances de la distribution des données. Cette flexibilité permet de capturer même les divisions de classe les plus complexes.

Le noyau dans l’apprentissage automatique est comme un joyau caché. Ils dévoilent le potentiel latent des données en révélant des relations complexes qui peuvent ne pas être apparentes sous leur forme originale. En permettant aux algorithmes d’effectuer des transformations non linéaires sans effort, les noyaux élèvent les capacités des modèles d’apprentissage automatique.

Comprendre les noyaux permet aux data scientists de résoudre des problèmes complexes dans tous les domaines, favorisant ainsi l’innovation et le progrès dans le domaine. À mesure que nous progressons dans l’apprentissage automatique, rappelons-nous que les noyaux sont la clé pour déverrouiller les modèles cachés et percer les mystères des données.

Crédit image en vedette: rawpixel.com/Freepik.