Mistral Large 2 est arrivé sur le marché, marquant une avancée majeure dans la technologie des modèles de langage. Cette nouvelle offre de Mistral AI contient un nombre impressionnant de 123 milliards de paramètres et dispose d’une fenêtre de contexte de 128 000 jetons. La sortie de Mistral Large 2 signale une concurrence croissante entre les principales entreprises d’IA pour développer des modèles toujours plus performants.

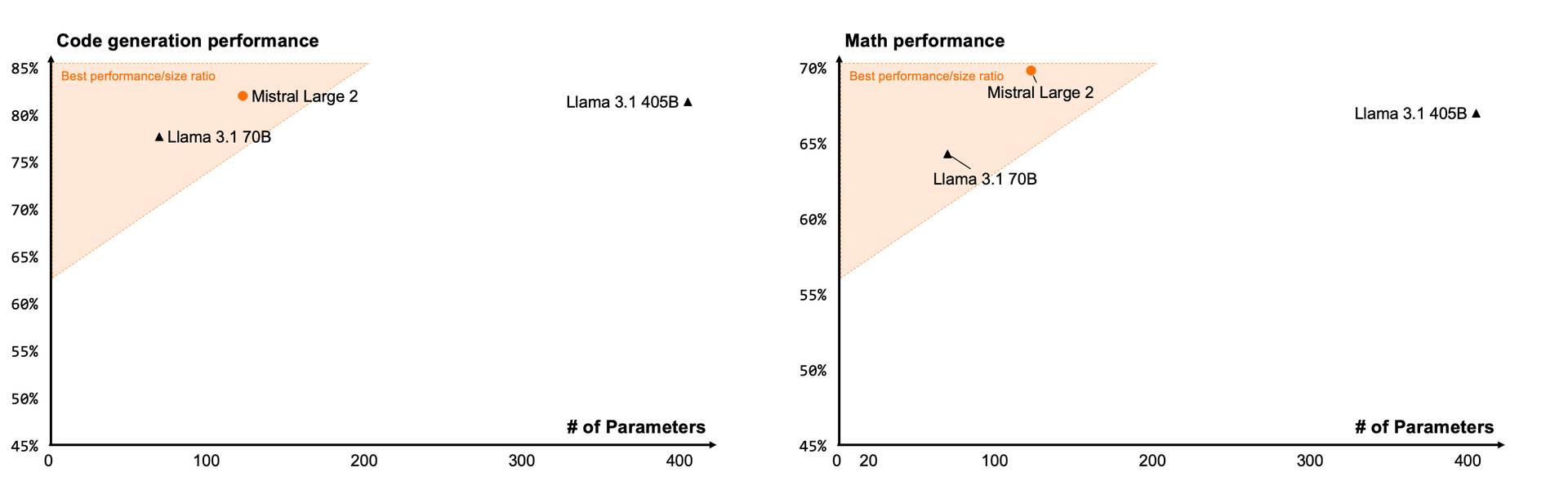

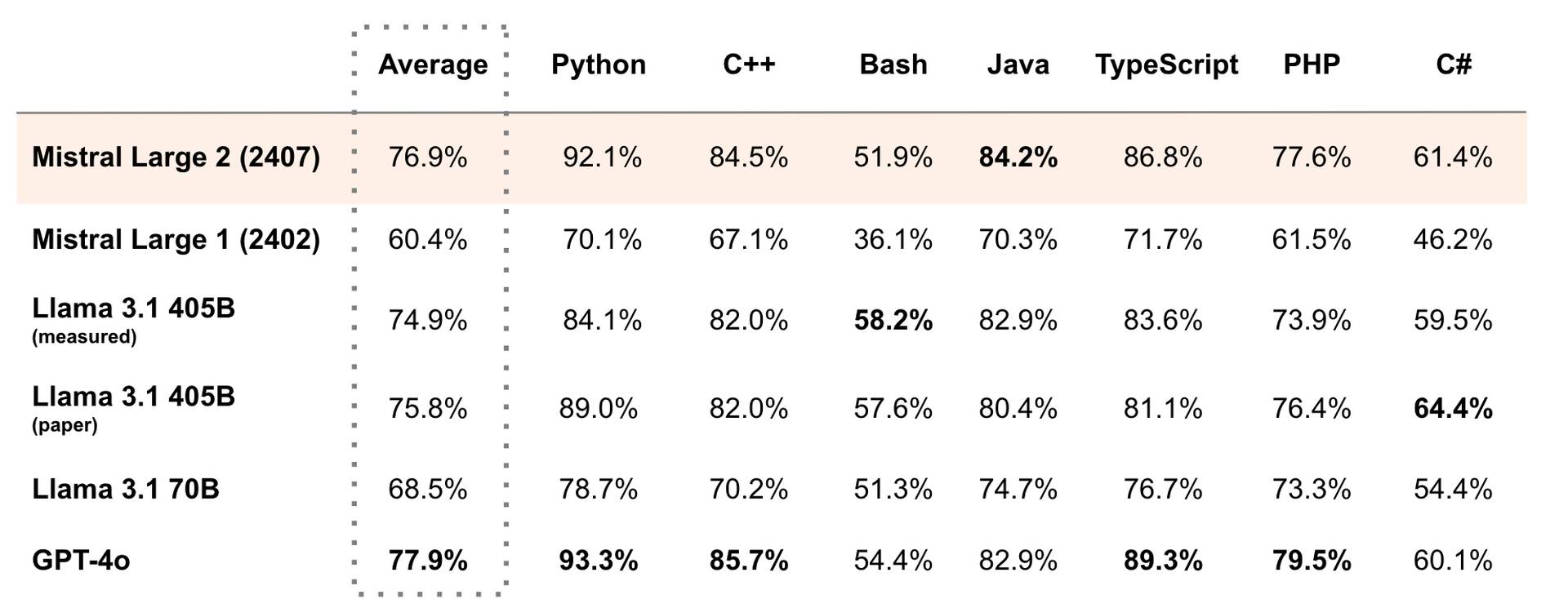

Suite au lancement de Méta Llama 3.1 405bMistral Large 2 fait ses preuves dans les tests de performance clés. Dans les tâches de codage comme HumanEval, il surpasse les autres modèles récents tout en se rapprochant du leader du secteur GPT-4. Pour les problèmes mathématiques, notamment sur le test MATH, Mistral Large 2 se classe juste derrière GPT-4. Le modèle fait également jouer ses muscles multilingues, surpassant ses concurrents dans plusieurs langues sur le test multilingue MMLU.

Malgré sa grande envergure, Mistral AI a conçu Mistral Large 2 pour fonctionner efficacement sur une seule machine. Cette focalisation sur le débit le rend particulièrement adapté aux applications nécessitant le traitement de longues entrées de texte.

Un regard plus approfondi sur les spécifications techniques du Mistral Large 2

En examinant les détails techniques, on découvre ce qui fait fonctionner Mistral Large 2. Ses 123 milliards de paramètres lui donnent la capacité de capturer des modèles nuancés dans le langage et les connaissances. Fenêtre de contexte de 128 000 jetons permet de maintenir une cohérence sur de très longs passages de texte.

Mistral AI a déployé des efforts considérables pour perfectionner les capacités de codage du modèle. S’appuyant sur leurs travaux antérieurs avec des modèles axés sur le code, ils ont formé Mistral Large 2 de manière approfondie sur les langages de programmation. La formation spécialisée se reflète dans ses excellentes performances sur les tests de codage, rivalisant avec les meilleurs modèles de OpenAI et Anthropique.

Les développeurs ont également donné la priorité à l’amélioration des capacités de raisonnement de Mistral Large 2 et à la réduction des résultats insensés. Un réglage minutieux a permis de minimiser la tendance du modèle à générer des informations plausibles mais incorrectes. En conséquence, Mistral Large 2 présente une précision améliorée sur les problèmes mathématiques et autres tâches nécessitant un raisonnement logique.

Mistral Large 2 parle plusieurs langues

Une caractéristique remarquable du Mistral Large 2 est son prouesse multilingueLe modèle a été formé sur des textes couvrant des dizaines de langues, ce qui lui permet de comprendre et de générer du contenu de haute qualité dans différentes variations linguistiques.

Les principales langues prises en charge incluent :

- Français

- Allemand

- Espagnol

- italien

- Portugais

- arabe

- hindi

- russe

- Chinois

- Japonais

- coréen

La large couverture linguistique fait de Mistral Large 2 un outil polyvalent pour les entreprises mondiales et des applications multilingues. Les tests de référence confirment les performances du Mistral Large 2 atouts multilingues. Lors du test multilingue MMLU, il a surpassé les autres modèles récents dans neuf langues différentes. Cette performance multilingue constante met en évidence le potentiel du modèle à briser les barrières linguistiques dans divers domaines.

Ce ne sont pas seulement les langues parlées, Mistral connaît le langage de programmation comme un livre!

Dans les tâches de codage, Mistral Large 2 peut travailler avec plus de 80 langages de programmation. Python, Java, C, C++, JavaScript et Bash ne sont que quelques-unes des options prises en charge. Cette flexibilité linguistique, tant dans les langages humains que informatiques, distingue Mistral Large 2 dans le paysage actuel de l’IA.

S’attaquer au problème des hallucinations

L’un des principaux objectifs du développement de Mistral Large 2 a été de réduire les hallucinations, ces résultats plausibles mais incorrects qui empoisonnent de nombreux modèles linguistiques. Mistral AI a entraîné le modèle à être plus perspicace et prudent dans ses réponses. Face à l’incertitude, Mistral Large 2 est conçu pour reconnaître les lacunes de ses connaissances plutôt que d’inventer de fausses informations.

L’accent mis sur l’exactitude et la véracité répond à une critique courante des grands modèles linguistiques. En s’efforçant de minimiser les hallucinations, Mistral AI vise à rendre son modèle plus fiable et digne de confiance pour les applications du monde réel.

Le financement est là aussi

Bien qu’elle soit relativement nouvelle, Mistral AI s’est rapidement imposée comme un acteur sérieux de l’intelligence artificielle. La startup basée à Paris a récemment obtenu un financement de série B de 640 millions de dollars, atteignant une valorisation de 6 milliards de dollarsLe soutien financier, combiné à leur capacité à développer rapidement des modèles de pointe, positionne Mistral comme une force croissante dans l’industrie de l’IA.

La pièce manquante

Un domaine où Mistral Large 2 (et le récent Meta Lama 3.1) est à la traîne en ce qui concerne la fonctionnalité multimodale. OpenAI est actuellement en tête du peloton dans le développement de systèmes d’IA capables de traiter simultanément du texte et des images. Cette capacité est de plus en plus demandée, de nombreuses startups cherchant à intégrer des fonctionnalités multimodales à leurs applications.

Accessibilité et intégration

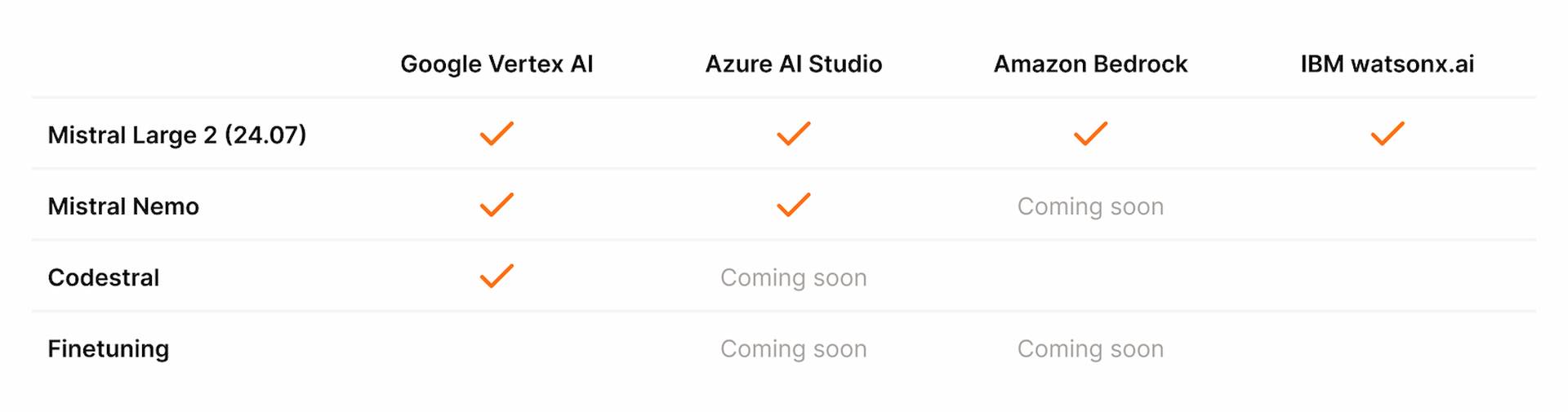

Mistral Large 2 est désormais disponible sur les principales plateformes cloud, notamment :

Les développeurs peuvent également y accéder directement via la propre plateforme de Mistral, la Plateformeet dans HugginFace sous le nom «mistral-grand-2407« .

Pour ceux qui souhaitent expérimenter, Mistral propose de tester gratuitement le modèle sur leur ChatGPT concurrent, le chat. Cette accessibilité sur plusieurs plateformes permet aux développeurs et aux entreprises d’intégrer plus facilement Mistral Large 2 dans leurs projets et flux de travail.

Il convient toutefois de noter que, comme de nombreux modèles d’IA avancés, Mistral Large 2 n’est pas véritablement open source. Bien que plus accessible que certains concurrents, son utilisation commerciale nécessite néanmoins une licence payante. La complexité technique de la mise en œuvre d’un modèle aussi vaste limite également sa disponibilité pratique pour la plupart des utilisateurs.

Alors que les modèles d’IA continuent d’évoluer à un rythme effréné, Mistral Large 2 représente une nouvelle avancée dans les capacités des modèles de langage. Son accent sur l’efficacité, la précision et la polyvalence en fait un ajout remarquable à l’écosystème croissant d’outils d’IA avancés. Bien que des défis subsistent, notamment dans le traitement multimodal, les progrès rapides de Mistral suggèrent qu’elle restera une entreprise à surveiller dans la course actuelle à l’IA.

Crédit de l’image en vedette: Mistral IA