Dans un monde dominé par des modèles d’IA volumineux qui vivent dans le cloud, Mistral AI inverse la donne. La startup française vient déchaîné deux nouveaux modèles, Ministral 3B et 8B, conçus pour fonctionner sur des appareils Edge.

Les Ministraux : Ministral 3B et 8B

Les nouvelles offres de Mistral, baptisées « Les Ministraux », peuvent ressembler à un film d’art et d’essai français, mais ces modèles sont sur le point de bouleverser le monde de l’IA. Avec respectivement seulement 3 milliards et 8 milliards de paramètres, la famille Ministraux est axée sur l’efficacité. Oubliez ces modèles d’IA gourmands en ressources qui nécessitent un centre de données pour fonctionner.

« Nos clients et partenaires les plus innovants demandent de plus en plus une inférence locale, axée sur la confidentialité, pour les applications critiques », a expliqué Mistral.

Une longueur de contexte comme jamais auparavant

C’est ici que les choses deviennent vraiment piquantes : les modèles 3B et 8B peuvent gérer une fenêtre contextuelle de 128 000 jetons. C’est l’équivalent d’un livre de 50 pages. À titre de comparaison, même OpenAI GPT-4 Turbo plafonne autour du même nombre de jetons, et ce n’est pas une mince affaire.

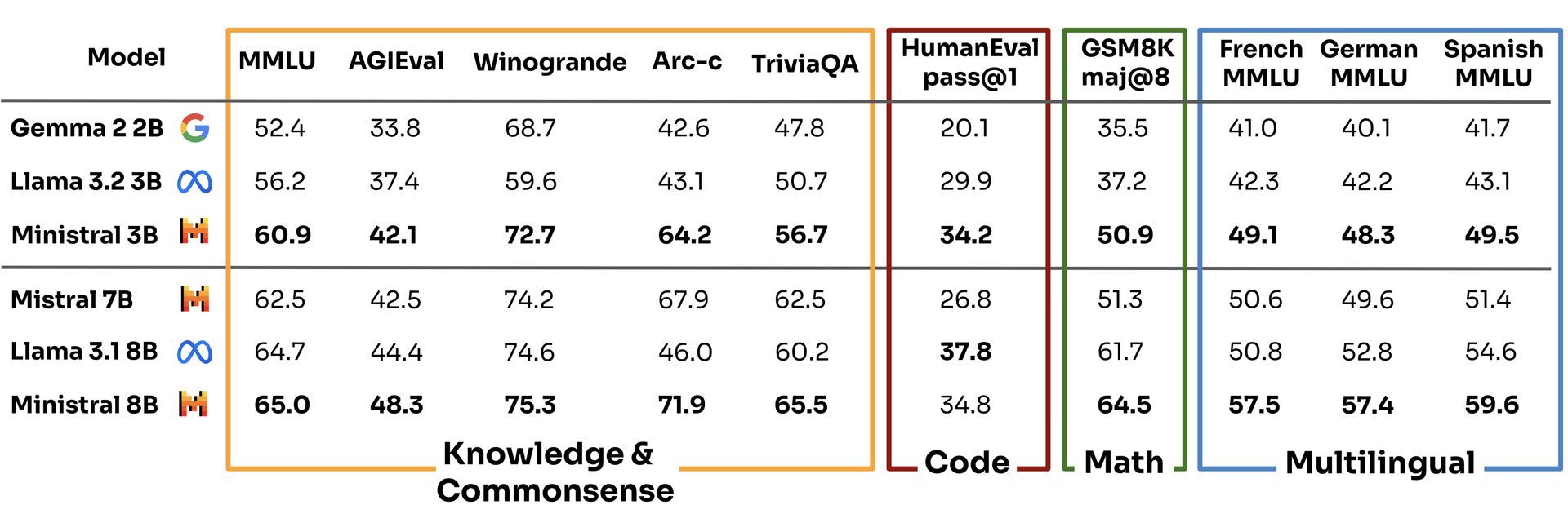

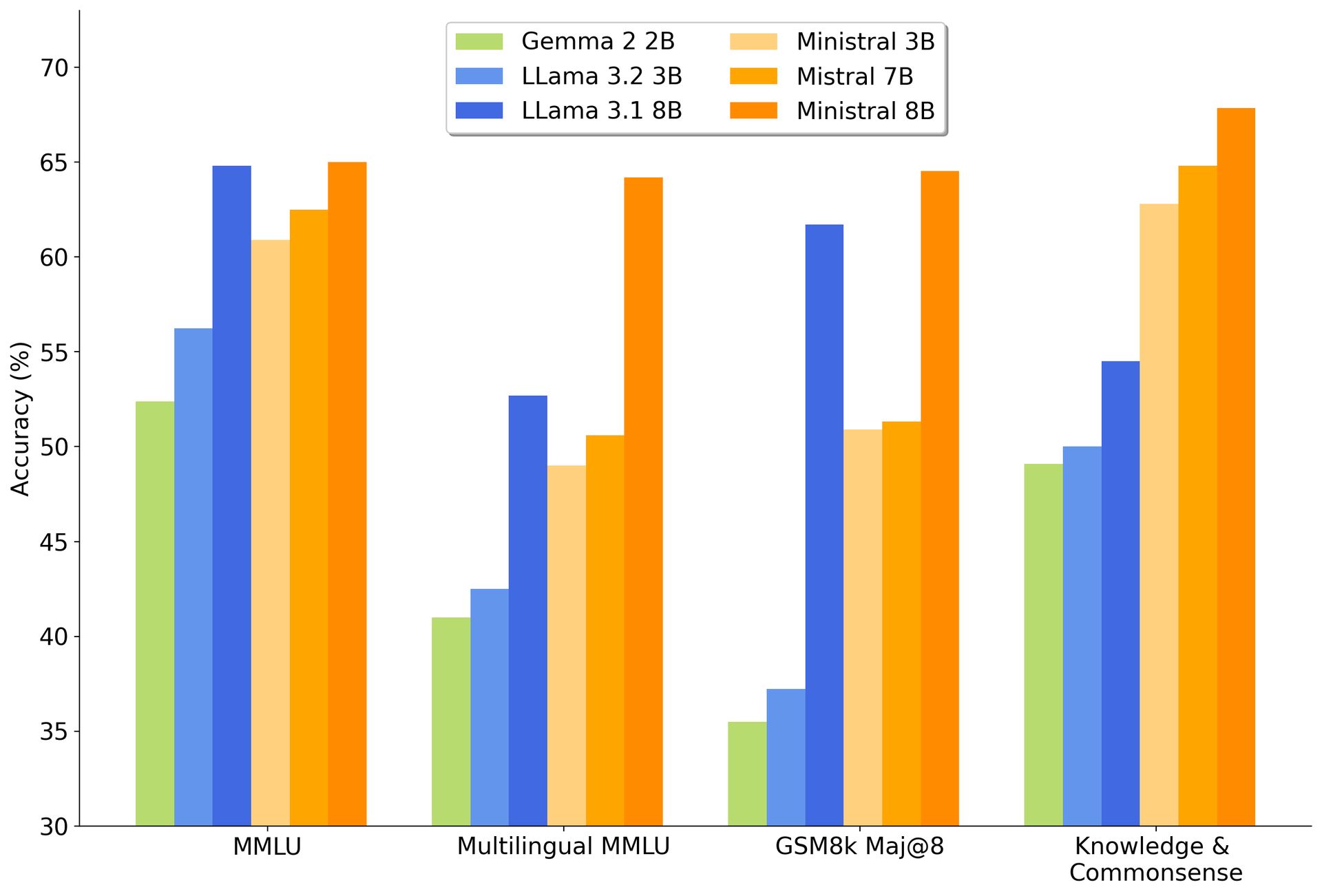

Avec ce type de capacité, les modèles Ministraux ne se contentent pas de surpasser leur prédécesseur, le Mistral 7B, ils mangent également celui de Google. Gemma 2 2B et Les modèles de lamas de Meta pour le petit déjeuner.

Selon les propres benchmarks de Mistral, le modèle 3B a obtenu un score de 60,9 dans l’évaluation de compréhension du langage multitâche, laissant les concurrents comme Llama 3.2 3B et Gemma 2 2B à 56,2 et 52,4, respectivement.

Pas mal pour un modèle « plus petit », non ?

Alors que tout le monde dans le monde de l’IA s’efforce de créer des modèles plus grands et plus méchants qui consomment de l’énergie, Mistral joue à un jeu différent. En fonctionnant sur des appareils locaux, Les Ministraux éliminent le besoin de serveurs cloud massifs et, ce faisant, proposent une option beaucoup plus respectueuse de l’environnement. C’est une décision qui s’aligne parfaitement avec la pression croissante exercée sur les entreprises technologiques pour qu’elles soient plus soucieuses de l’environnement. L’IA est peut-être l’avenir, mais personne ne veut que cet avenir se fasse au détriment de la planète.

Il y a aussi la question de la vie privée. Comme tout fonctionne localement, vos données restent sur votre appareil, ce qui constitue une énorme victoire pour des secteurs comme la santé et la finance, qui sont de plus en plus scrutés à la loupe pour la manière dont ils traitent les informations sensibles. Vous pouvez y voir une IA sans surveillance – un changement rafraîchissant dans un monde où chaque application semble collecter plus de données que la NSA.

Le plan directeur de Mistral : construire, perturber, répéter

Mais ne nous leurrons pas : Mistral ne fait pas cela uniquement pour le bien commun. L’entreprise, cofondée par des anciens de Meta et de DeepMind de Google, a pour mission de faire des vagues. Ils ont déjà levé 640 millions de dollars en capital-risque et se concentrent sur la création de modèles d’IA qui non seulement rivalisent avec GPT-4 d’OpenAI et Claude d’Anthropic, mais génèrent également des bénéfices dans le processus.

Et même si gagner de l’argent dans le domaine de l’IA générative est aussi simple que de gagner à la loterie, Mistral ne recule pas. En fait, ils ont commencé à générer des revenus l’été dernier, ce qui est plus que ce que l’on peut dire pour beaucoup de leurs concurrents.

En proposant Ministral 8B à des fins de recherche et en rendant les deux modèles disponibles via sa plateforme cloud La Plateforme, Mistral se positionne comme l’enfant cool du bloc IA : suffisamment ouvert pour attirer les développeurs, mais suffisamment intelligent pour monétiser sa technologie grâce à des partenariats stratégiques. Il s’agit d’une approche hybride qui reflète ce que des géants de l’open source comme Red Hat ont fait dans le monde Linux, favorisant la communauté tout en faisant sonner les caisses enregistreuses.

Crédits images : Mistral