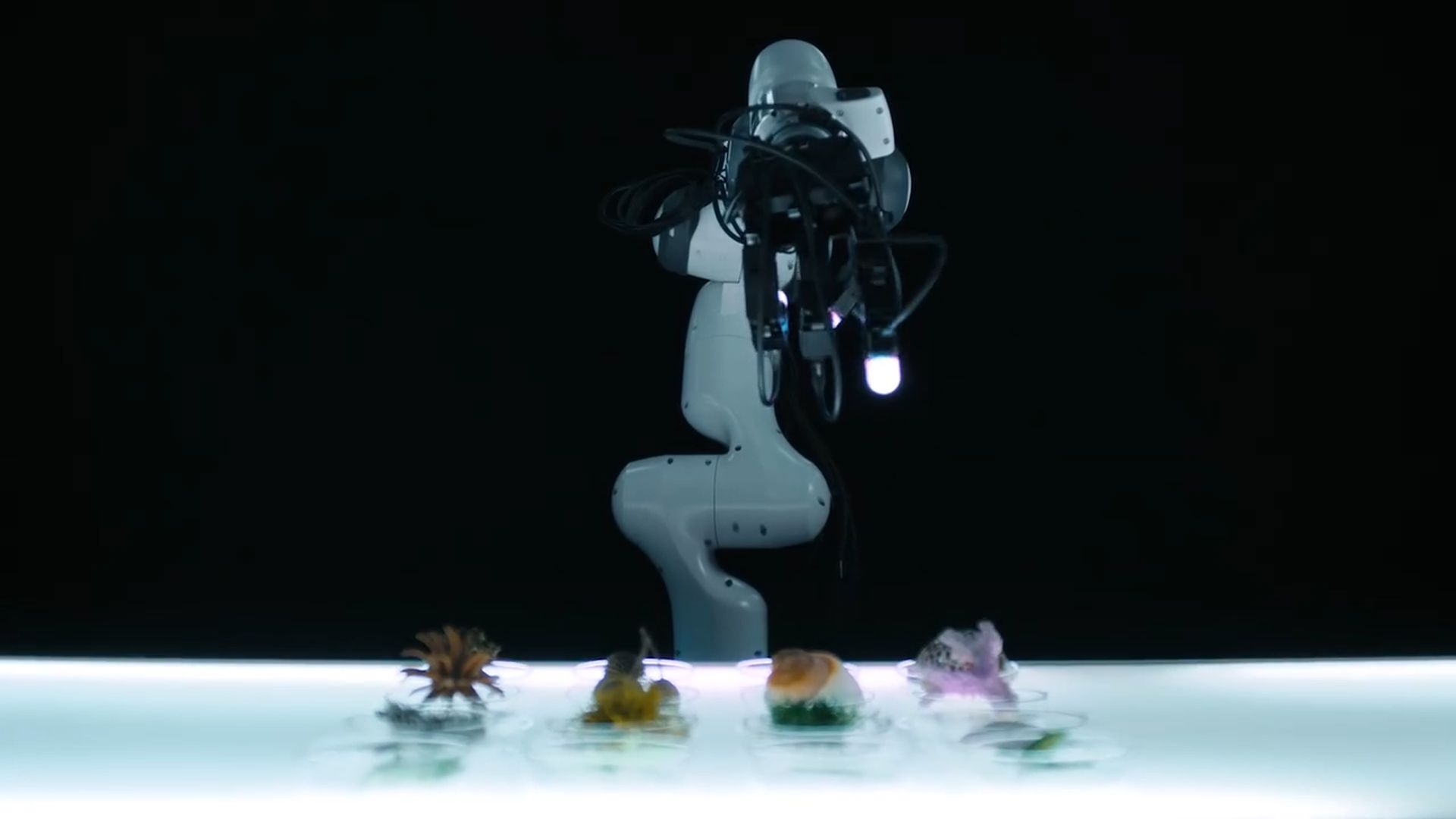

Dans ce que beaucoup appellent « l’année de l’IA incorporée », Meta a fait un grand pas dans l’avancement des capacités robotiques grâce à une suite de nouvelles technologies. La division Fundamental AI Research (FAIR) de Meta a récemment introduit trois artefacts de recherche : Meta Sparsh, Meta Digit 360 et Meta Digit Plexus, chacun apportant des progrès en matière de perception tactile, de dextérité et de collaboration homme-robot.

Qu’est-ce que l’IA incarnée et pourquoi est-ce important ?

L’IA incorporée fait référence aux systèmes d’intelligence artificielle conçus pour exister et fonctionner dans le monde physique, comprenant et interagissant avec leur environnement de manière à imiter la perception et les actions humaines. Les systèmes d’IA traditionnels excellent dans l’analyse des données, mais ne sont pas à la hauteur lorsqu’ils sont appliqués à des tâches physiques, qui nécessitent non seulement une vision, mais également un retour sensoriel tel que le toucher. En créant une IA incarnée, les chercheurs visent à créer des robots capables de détecter, de réagir et même de s’adapter à leur environnement, comblant ainsi le fossé entre l’intelligence numérique et les fonctionnalités du monde réel.

Les innovations de Meta en matière d’IA incarnée visent à réaliser ce que son scientifique en chef de l’IA, Yann LeCun, appelle Advanced Machine Intelligence (AMI). Ce concept envisage des machines capables de raisonner sur les causes et les effets, de planifier des actions et de s’adapter aux changements de leur environnement, passant ainsi de simples outils à des assistants collaboratifs.

Qu’est-ce que la Meta AI aujourd’hui ?

Les percées de Meta dans l’IA incarnée : Sparsh, Digit 360 et Digit Plexus

Les récentes annonces de Meta soulignent son engagement à s’attaquer aux limites de la technologie robotique actuelle. Explorons les capacités de chaque nouvel outil.

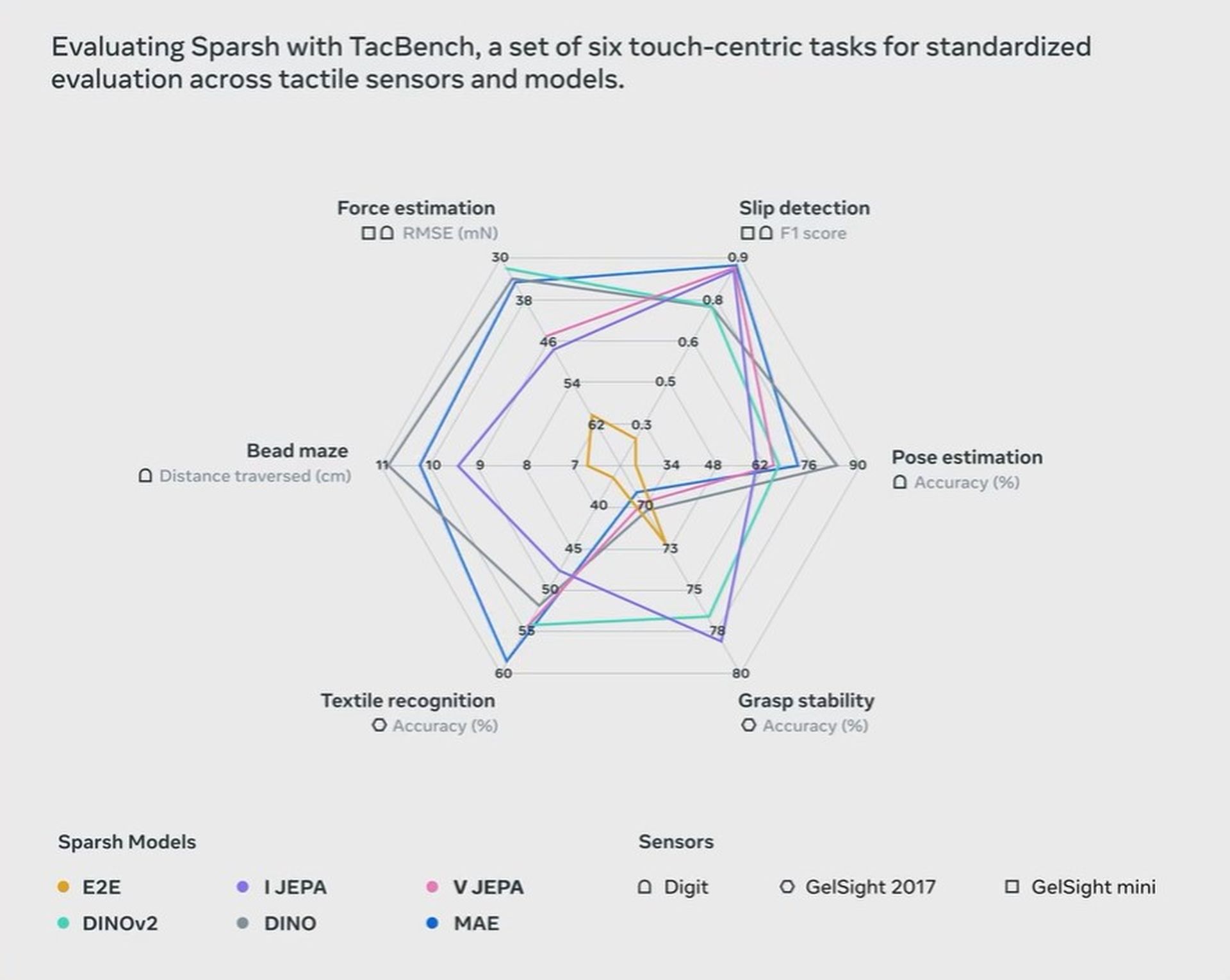

Meta Sparsh : le fondement de la détection tactile

Meta Sparsh, qui signifie « toucher » en sanskrit, est le premier modèle de détection tactile basé sur la vision qui permet aux robots de « sentir » des surfaces et des objets. Sparsh est un encodeur polyvalent qui s’appuie sur une base de données de plus de 460 000 images tactiles pour apprendre aux robots à reconnaître et interpréter le toucher. Contrairement aux modèles traditionnels qui nécessitent une formation spécifique à une tâche, Sparsh exploite un apprentissage auto-supervisé, lui permettant de s’adapter à diverses tâches et capteurs sans avoir besoin de données étiquetées étendues.

Cette capacité de généralisation est essentielle pour les robots qui doivent effectuer un large éventail de tâches. Sparsh fonctionne avec divers capteurs tactiles, s’intégrant parfaitement à différentes configurations robotiques. En permettant aux robots de percevoir le toucher, Sparsh ouvre des opportunités dans des domaines où la manipulation adroite et le retour tactile sont essentiels, comme dans les applications médicales, la chirurgie robotique et la fabrication de précision.

Meta Digit 360 : détection tactile au niveau humain en robotique

Digit 360 est le nouveau capteur tactile du bout des doigts de Meta conçu pour reproduire le toucher humain. Équipé de 18 fonctions de détection distinctes, Digit 360 fournit des données tactiles très détaillées qui peuvent capturer des changements infimes dans la surface, la force et la texture d’un objet. Construit avec plus de 8 millions de « taxels » (pixels tactiles), Digit 360 permet aux robots de détecter des forces aussi subtiles que 1 millinewton, améliorant ainsi leur capacité à effectuer des tâches complexes et nuancées.

Cette percée dans la détection tactile a des applications pratiques dans divers domaines. Dans le domaine de la santé, Digit 360 pourrait être utilisé dans les prothèses pour donner aux patients un sens du toucher accru. En réalité virtuelle, cela pourrait améliorer les expériences immersives en permettant aux utilisateurs de « ressentir » des objets dans des environnements numériques. Meta s’associe à GelSight Inc pour commercialiser Digit 360, dans le but de le rendre accessible à la communauté de recherche plus large d’ici l’année prochaine.

Meta Digit Plexus : une plate-forme pour les mains de robots tactiles

La troisième version majeure de Meta, Digit Plexus, est une plate-forme matérielle-logicielle standardisée conçue pour intégrer divers capteurs tactiles sur une seule main robotique. Digit Plexus combine des capteurs du bout des doigts et de la paume, offrant aux robots un système de réponse tactile plus coordonné et semblable à celui d’un humain. Cette intégration permet aux robots de traiter les retours sensoriels et d’effectuer des ajustements en temps réel pendant les tâches, de la même manière que les mains humaines.

En standardisant le retour tactile sur la main robotique, Digit Plexus améliore le contrôle et la précision. Meta envisage des applications pour cette plateforme dans des domaines tels que la fabrication et la maintenance à distance, où la manipulation délicate des matériaux est essentielle. Pour aider à créer une communauté robotique open source, Meta met à disposition gratuitement les conceptions logicielles et matérielles pour Digit Plexus.

Partenariats de Meta avec GelSight Inc et Wonik Robotics

En plus de ces avancées technologiques, Meta a conclu des partenariats pour accélérer l’adoption de la détection tactile en robotique. En collaboration avec GelSight Inc et Wonik Robotics, Meta vise à apporter ses innovations aux chercheurs et développeurs du monde entier. GelSight Inc se chargera de la distribution de Digit 360, tandis que Wonik Robotics fabriquera l’Allegro Hand, une main robot intégrée à Digit Plexus, dont le lancement est prévu l’année prochaine.

Ces partenariats sont importants car ils représentent une évolution vers la démocratisation de la technologie robotique. En rendant ces systèmes tactiles avancés largement disponibles, Meta favorise un écosystème collaboratif qui pourrait générer de nouvelles applications et améliorer les performances des robots dans tous les secteurs.

PARTNR : Une nouvelle référence pour la collaboration homme-robot

Meta présente également PARTNR (Planning And Reasoning Tasks in human-Robot collaboration), une référence conçue pour évaluer les modèles d’IA sur les interactions homme-robot dans les ménages. Construit sur le simulateur Habitat 3.0, PARTNR offre un environnement réaliste dans lequel les robots peuvent interagir avec les humains à travers des tâches complexes, allant des tâches ménagères à la navigation dans le monde physique.

Avec plus de 100 000 tâches basées sur le langage, PARTNR offre un moyen standardisé de tester l’efficacité des systèmes d’IA dans des scénarios collaboratifs. Ce benchmark vise à stimuler la recherche sur des robots qui agissent comme des « partenaires » plutôt que comme de simples outils, les dotant de la capacité de prendre des décisions, d’anticiper les besoins humains et de fournir une assistance au quotidien.

Crédits images : Méta