Deepseek-R1 domine les discussions technologiques sur les forums Reddit, X et Developer, les utilisateurs l’appelant «l’IA populaire» pour sa capacité étrange à rivaliser avec des modèles payants comme Google Gemini et le GPT-4O d’Openai – tout en ne coûtant rien.

Deepseek-R1un Raisonnement gratuit et open source AIpropose une alternative privilégiée en confidentialité au modèle O1 de 200 $ / mois d’OpenAI, avec des performances comparables en codage, mathématiques et résolution de problèmes logiques. Ce guide fournit des instructions étape par étape pour installer Deepseek-R1 localement et l’intégrer dans des projets, économisant des centaines de dollars par mois.

Pourquoi Deepseek-R1 est-il tendance?

Contrairement aux modèles fermés qui verrouillent les utilisateurs dans les abonnements et les accords de partage de données, Deepseek-R1 fonctionne entièrement hors ligne lors du déploiement local. Les repères de médias sociaux montrent qu’il résolvant les problèmes de leetcode 12% plus rapidement que O1 d’Openai modèle tout en utilisant seulement 30% des ressources système. Une démo Tiktok en codant un tracker de dépenses basé sur Python en 90 secondes a accumulé 2,7 millions de vues, avec des commentaires comme «Gemini ne pourrait jamais» inonder le fil. Son appel? Pas de frais d’API, pas de plafonds d’utilisation et aucune connexion Internet obligatoire.

Qu’est-ce que Deepseek-R1 et comment se compare-t-il à Openai-O1?

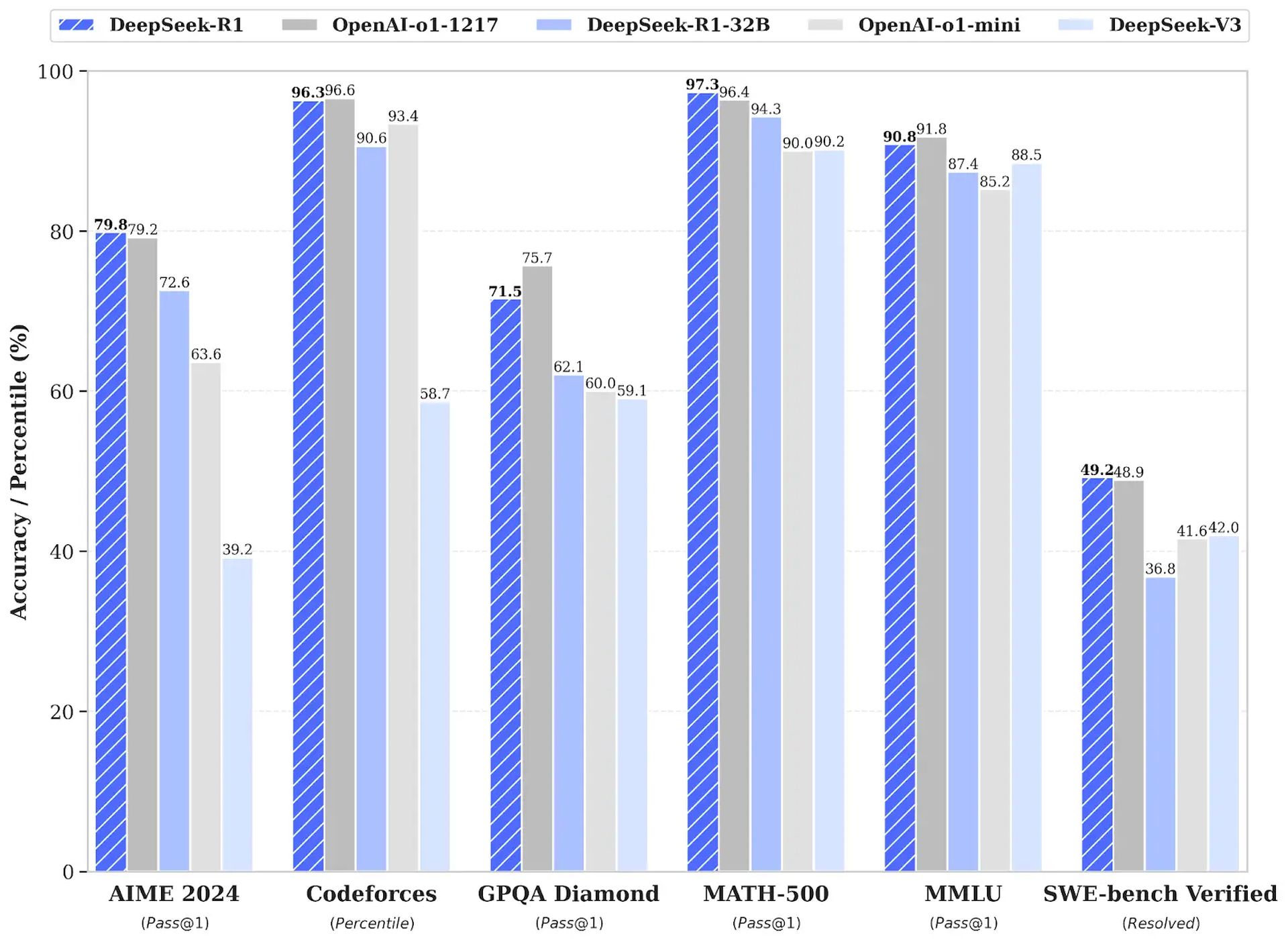

Deepseek-R1 est une IA de raisonnement révolutionnaire qui utilise l’apprentissage du renforcement (RL) au lieu d’un réglage fin supervisé, réalisant un score de 79,8% @ 1 sur la référence mathématique AIME 2024. Il surpasse OpenAI-O1 en rentabilité, l’API coûte 96,4% moins cher (0,55 $ contre 15 $ par million de jetons d’entrée) et la possibilité d’exécuter localement le matériel de consommation. Deepseek-R1 est open-source, offrant six modèles distillés allant de 1,5b à 671B pour diverses applications.

Guide d’installation étape par étape pour Deepseek-R1 (local)

Pour installer Deepseek-R1 localement à l’aide d’Ollama et d’ouvrir une interface utilisateur Web, suivez ces étapes:

1. Installer Ollla via Terminal (macOS / Linux):

curl -fsSL https://ollama.com/install.sh | sh ollama -v #check Ollama version2. Téléchargez un modèle distillé Deepseek-R1 via Olllama:

# Default 7B model (4.7GB - ideal for consumer GPUs)

ollama run deepseek-r1

# Larger 70B model (requires 24GB+ VRAM)

ollama run deepseek-r1:70b

# Full DeepSeek-R1 (requires 336GB+ VRAM for 4-bit quantization)

ollama run deepseek-r1:671b3. Configurez l’interface utilisateur Web ouvrir pour une interface privée:

docker run -d -p 3000:8080

--add-host=host.docker.internal:host-gateway

-v open-webui:/app/backend/data

--name open-webui

--restart always

ghcr.io/open-webui/open-webui:mainAccéder à l’interface à http: // localhost: 3000 et sélectionner deepseek-r1:latest. Toutes les données restent sur votre machine, garantissant la confidentialité.

Comment intégrer Deepseek-R1 dans vos projets

Deepseek-R1 peut être intégré localement ou via son API Cloud:

1. Déploiement local (confidentialité-première):

import openai

Connect to your local Ollama instance

client = openai.Client(

base_url="http://localhost:11434/v1",

api_key="ollama" # Authentication-free private access

)

response = client.chat.completions.create(

model="deepseek-r1:XXb ", # change the "XX" by the distilled model you choose

messages=[{"role": "user", "content": "Explain blockchain security"}],

temperature=0.7 # Controls creativity vs precision

)2. Utilisation de l’API Cloud Deepseek-R1 officielle:

import openai from dotenv import load_dotenv import os

load_dotenv()

client = openai.OpenAI(

base_url="https://api.deepseek.com/v1",

api_key=os.getenv("DEEPSEEK_API_KEY")

)

response = client.chat.completions.create(

model="deepseek-reasoner",

messages=[{"role": "user", "content": "Write web scraping code with error handling"}],

max_tokens=1000 # Limit costs for long responses

)Deepseek-R1 fournit une alternative rentable et axée sur la confidentialité à OpenAI-O1, idéal pour les développeurs qui cherchent à économiser de l’argent et à maintenir la sécurité des données. Pour plus d’assistance ou pour partager des expériences, les utilisateurs sont encouragés à s’engager avec la communauté.

Crédit d’image en vedette: En profondeur