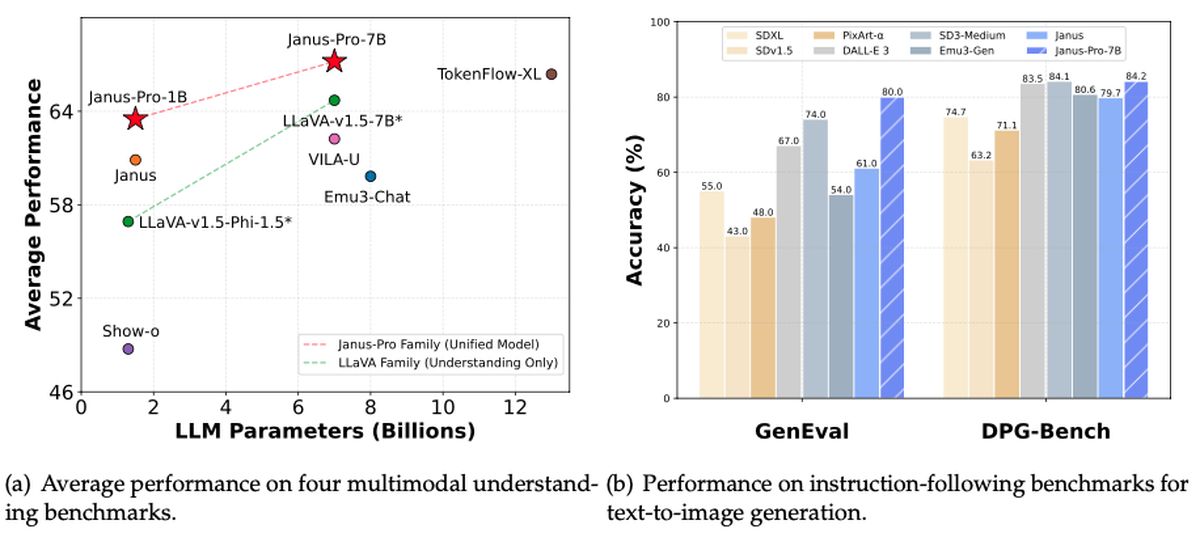

DeepSeek a dévoilé une autre contribution majeure au paysage de l’IA open source. Cette fois, il s’agit du Janus-Pro-7B : une centrale multimodale capable à la fois de comprendre et de générer des images. Selon Rowan Cheungle nouveau modèle éclipse non seulement DALL-E 3 et Stable Diffusion d’OpenAI dans des benchmarks comme GenEval et DPG-Bench, mais montre également le même esprit « disponible gratuitement » qui a fait du précédent modèle R1 de DeepSeek une sensation virale. Les investisseurs, quant à eux, s’efforcent de donner un sens à la montée en puissance des avancées en matière d’IA, avec L’action NVIDIA en baisse de plus de 17% à midi.

Janus-Pro-7B pourrait-il être le prochain grand perturbateur sur un marché technologique déjà turbulent ?

Qu’est-ce que DeepSeek Janus-Pro-7B ?

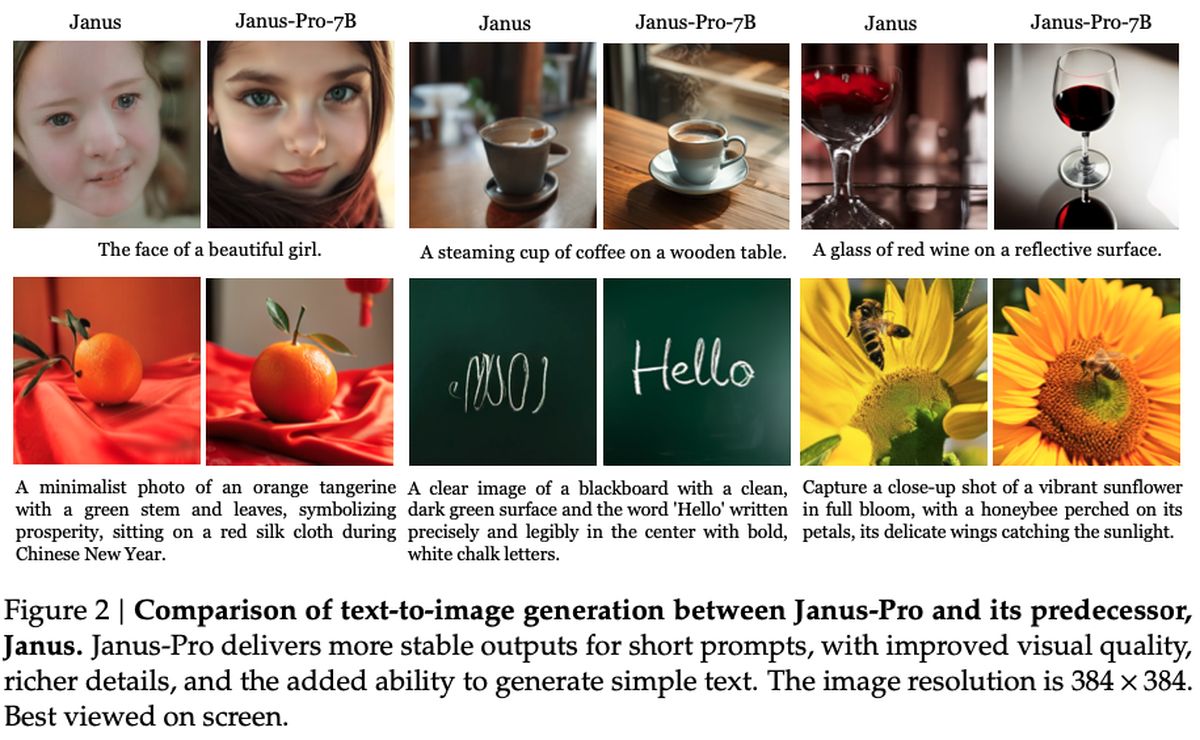

Sous le capot, Janus-Pro-7B cherche à combler le fossé entre un traitement de vision puissant et une génération rapide de texte. En empruntant une nouvelle approche de découplage à son encodeur SigLIP-L, le système peut analyser rapidement une image 384 x 384 avant de passer en mode de sortie créative. Il correspond, voire surpasse, de nombreux modèles spécialisés dans l’espace, une réalisation particulièrement frappante étant donné qu’il reste également remarquablement facile à personnaliser et à étendre.

Les analystes soulignent la philosophie cohérente de DeepSeek : le garder open source, donner la priorité à la confidentialité et saper ses concurrents basés sur l’abonnement. Janus-Pro-7B semble être performant sur les trois fronts, établissant des performances élevées tout en préservant l’accessibilité qui a attiré les fans vers les capacités hors ligne de DeepSeek-R1.

En termes purement factuels, Janus-Pro-7B est sous licence permissive Cadre du MITavec des directives d’utilisation supplémentaires de DeepSeek. Le modèle s’intègre aux projets en aval via un référentiel GitHub et n’utiliserait apparemment qu’un sous-échantillonnage 16x dans son pipeline de génération d’images. Les indicateurs actuels suggèrent que l’arrivée du Janus-Pro-7B pourrait déclencher une nouvelle concurrence entre les développeurs d’IA, même si seul le temps nous dira comment cette dernière offre gratuite affectera la zone IA.

Comment configurer DeepSeek-R1 facilement et gratuitement (en ligne et local) ?

Comment ça marche ?

Comme détaillé dans le document de recherche publié par DeepSeek, le modèle utilise un encodeur SigLIP-Large-Patch16-384, qui divise chaque image en patchs 16×16 à une résolution de 384×384. Cette approche préserve les détails fins, aidant ainsi le système à interpréter les images avec plus de précision. Du côté de la génération, Janus-Pro utilise un livre de codes de 16 384 jetons pour représenter les images à une échelle sous-échantillonnée de 16×, permettant des reconstructions efficaces qui rivalisent, voire surpassent, en qualité les modèles de diffusion traditionnels.

Deux adaptateurs MLP (Multi-Layer Perceptron) clés connectent ces composants de compréhension et de génération, garantissant ainsi un flux de données fluide entre les deux tâches. Pendant la formation, le modèle voit un mélange de données d’image et de texte, ce qui lui permet d’apprendre à la fois à interpréter des scènes visuelles et à produire ses propres images. Les sessions durent généralement de 7 à 14 jours sur des clusters GPU à grande échelle (pour les versions de paramètres 1,5B et 7B), avec des performances testées sur des benchmarks tels que GQA (pour la compréhension visuelle) et VisualGen (pour la création d’images). Le résultat est un framework polyvalent qui excelle dans les tâches multimodales, grâce à son architecture spécialisée mais cohérente.

Comment utiliser DeepSeek Janus-Pro-7B ?

Démarrer avec Janus-Pro-7B est aussi simple que de se rendre dans son référentiel GitHub officiel, de cloner ou de télécharger le code et d’installer les dépendances nécessaires. Le référentiel comprend un fichier README complet qui vous guide dans la configuration d’un environnement Python, l’extraction des poids du modèle et l’exécution d’exemples de scripts. En fonction de votre matériel, vous pouvez choisir entre le mode CPU uniquement ou exploiter l’accélération GPU pour des performances plus rapides. Quoi qu’il en soit, le processus d’installation reste simple, grâce à des conditions préalables bien documentées et des instructions étape par étape.

Une fois que tout est opérationnel, vous pouvez insérer des invites pour la génération de texte ou fournir des entrées d’image pour les capacités multimodales uniques du modèle. Des exemples de blocs-notes dans le référentiel montrent comment générer des sorties créatives, appliquer des transformations d’image avancées ou explorer des scénarios de « questions-réponses visuelles ». Pour les utilisateurs plus avancés, la conception modulaire du référentiel signifie que vous pouvez modifier les couches sous-jacentes, connecter vos propres ensembles de données ou même empiler le modèle avec d’autres versions de DeepSeek comme R1.