Kyutai, un laboratoire à but non lucratif dédié à l’avancement de la recherche ouverte en intelligence artificielle (IA), a fait des progrès significatifs avec sa dernière innovation, Moshi Chat. Ce modèle de base multimodal natif en temps réel de pointe représente une avancée remarquable dans la technologie de l’IA. L’introduction de Moshi Chat par Kyutai a attiré l’attention pour ses capacités impressionnantes, notamment dans les domaines de l’écoute et de la parole simultanées. Contrairement aux modèles d’IA traditionnels, Moshi Chat est conçu pour comprendre et exprimer les émotions, ce qui rend les interactions avec lui plus naturelles et engageantes.

Avec ses fonctionnalités uniques et sa disponibilité open source, Moshi Chat se distingue comme un pionnier dans le développement de l’IA.

Le développement de Moshi Chat témoigne de l’engagement de Kyutai en matière de transparence et d’innovation collaborative. La capacité du modèle à gérer deux flux audio simultanément—écouter et parler en temps réel— le distingue des autres modèles d’IA.

Cette capacité est soutenue par un processus de pré-formation conjoint robuste sur une combinaison de données textuelles et audio, utilisant des données textuelles synthétiques d’Helium, un Modèle de langage à 7 milliards de paramètres développé par KyutaiCes avancées dans la technologie de l’IA sont le résultat de recherches rigoureuses et d’ajustements visant à obtenir des performances fluides et efficaces.

La technologie de Kyutai Moshi Chat

La fonctionnalité remarquable de Moshi Chat est son capacité d’interaction en temps réelce qui lui permet d’écouter et de répondre simultanément. Cela est rendu possible grâce à un pré-entraînement conjoint sur un mélange de données textuelles et audio, garantissant que le modèle peut maintenir un flux fluide d’informations textuelles et auditives. La base des capacités de traitement de la parole de Moshi Chat est le modèle Helium, un modèle linguistique de 7 milliards de paramètres qui sert de colonne vertébrale à cette technologie innovante.

Selon le Le discours de Kyutai Moshi Chat sur YouTubele processus de réglage fin de Moshi Chat impliquait un vaste ensemble de données de 100 000 conversations synthétiques de « style oral »Ces conversations ont été converties à l’aide de la technologie Text-to-Speech (TTS), similaire à Murf IApermettant au modèle de générer et de comprendre la parole avec une précision remarquable. Le moteur TTS, prenant en charge 70 émotions et styles différents, a été affiné à l’aide de 20 heures d’audio enregistrées par des voix-off agréées. Cette approche méticuleuse de la formation a donné naissance à un modèle qui comprend non seulement le langage parlé mais transmet également des émotions et des nuancesrendant les interactions plus naturelles et engageantes.

L’engagement de Kyutai en faveur d’une utilisation responsable de l’IA est évident dans l’intégration du filigrane pour détecter les sons générés par l’IA. Cette fonctionnalité, toujours en cours de développement, souligne l’importance des considérations éthiques dans le développement de l’IA. De plus, la décision de publier Moshi Chat en tant que projet open source souligne l’engagement de Kyutai à favoriser une environnement collaboratif au sein de la communauté de l’IA.

Processus de formation et de mise au point de Moshi AI

Le développement de Moshi Chat a nécessité un processus rigoureux de formation et de réglage pour garantir son haut niveau de performance. Le modèle a été formé à partir de zéro en utilisant le modèle de langage textuel de base Helium 7B, qui a ensuite été formé conjointement avec des codecs texte et audio.

Le codec vocal, basé sur le modèle Mimi interne de Kyutai, dispose d’un Facteur de compression 300xqui contribue à préserver la qualité de l’audio tout en réduisant la taille des données.

Le processus de mise au point de Moshi Chat impliquait l’annotation 100 000 transcriptions très détaillées avec émotion et style. Ces annotations permettent au modèle de comprendre et de transmettre une large gamme d’émotions, rendant les interactions avec lui plus réalistes et engageantes. Le moteur de synthèse vocale, qui prend en charge 70 émotions et styles différents, a été peaufiné à l’aide de 20 heures d’audio enregistré par un talent vocal agréé nommé Alice.

L’accent mis par Kyutai sur l’adaptabilité est évident dans Moshi Chat possibilité de réglage précis avec moins de 30 minutes d’audio. Cette fonctionnalité permet aux utilisateurs de personnaliser le modèle en fonction de besoins spécifiques, que ce soit pour la recherche, l’apprentissage des langues ou d’autres applications. Le déploiement du modèle met en valeur son efficacité et sa polyvalence, gestion de deux tailles de lots à 24 Go de VRAM et prise en charge de plusieurs backendsDes optimisations dans le code d’inférence, telles que la mise en cache KV améliorée et la mise en cache des invites, devraient encore améliorer les performances de Moshi Chat.

La technologie pour tous grâce à Kyutai Labs

Moshi Chat n’est pas seulement une merveille technologique, il est également très accessible. Kyutai a développé une variante plus petite du modèle qui peut fonctionner sur un MacBook ou un GPU grand public, le rendant ainsi accessible à un plus large éventail d’utilisateurs.

L’efficacité du modèle est également démontrée par son déploiement sur des plateformes comme Scaleway et Visage qui fait un câlinoù il gère deux tailles de lots à 24 Go de VRAM, prenant en charge divers backends, notamment CUDA, Metal et CPU.

La voix du modèle, entraînée sur des données synthétiques générées par un modèle TTS distinct, atteint une latence de bout en bout impressionnante de 200 millisecondes. Cette faible latence est cruciale pour les interactions en temps réel, permettant à Moshi Chat de répondre presque instantanément aux entrées de l’utilisateur. La combinaison de techniques d’entraînement avancées et d’un code d’inférence optimisé, développé à l’aide de Rust, contribue aux performances supérieures du modèle. La mise en cache KV améliorée et la mise en cache des invites devraient également améliorer encore l’efficacité du modèle.

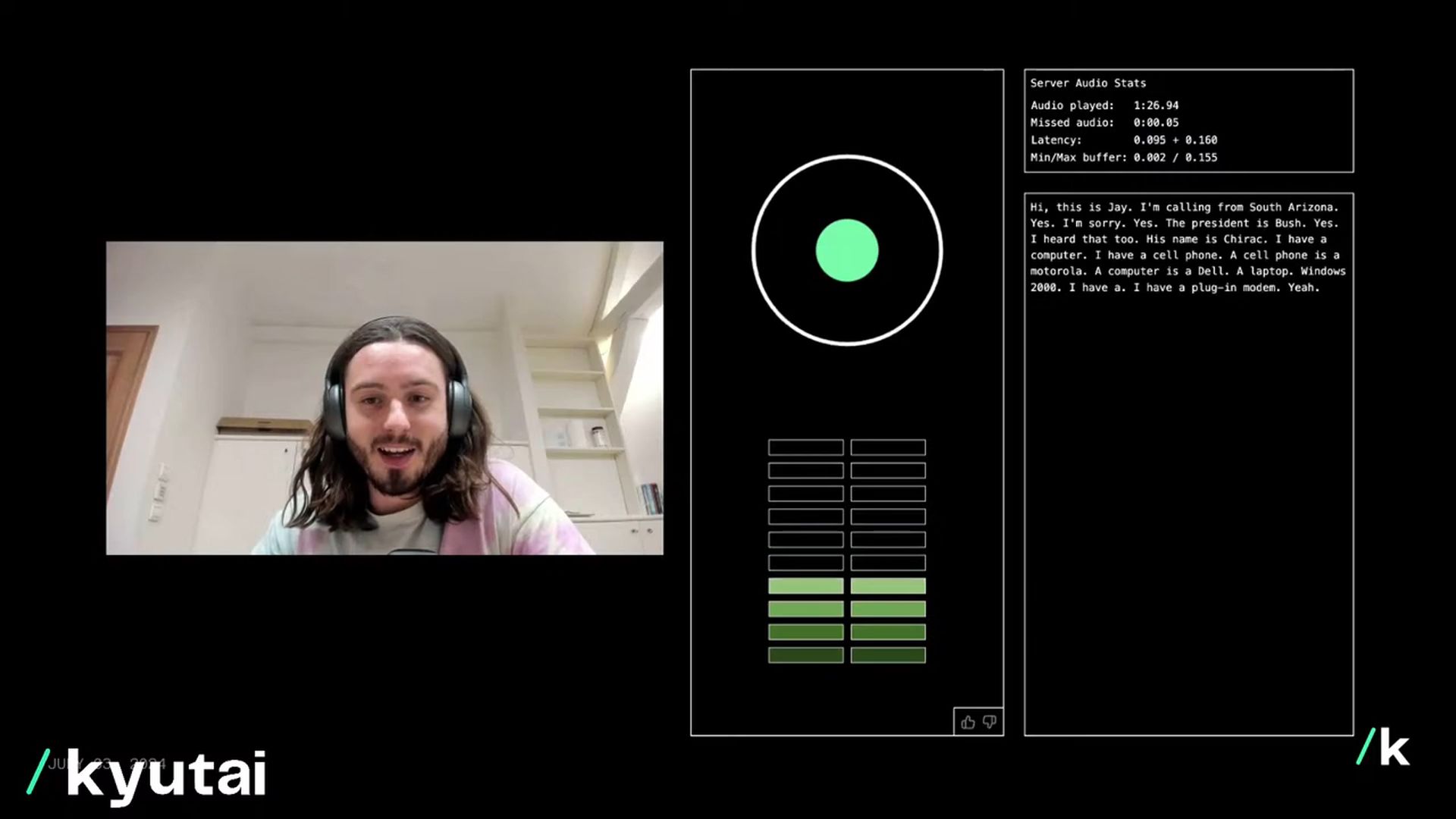

La démo postée par Yann LeCun montre à quel point ce nouveau modèle d’IA fonctionne bien.

Une démonstration en direct de Moshi de https://t.co/TngVXgSjzX https://t.co/qftjudOq1k

— Yann LeCun (@ylecun) 3 juillet 2024

Pour l’avenir, Kyutai a des projets ambitieux pour Moshi Chat. L’équipe prévoit de publier un rapport technique complet et des versions de modèles ouvertes, notamment la base de code d’inférence, le modèle 7B, le codec audio et la pile optimisée complète. Les futures itérations de Moshi Chat, telles que les versions 1.1, 1.2 et 2.0, intégreront les commentaires des utilisateurs pour affiner et améliorer les capacités du modèle.

L’octroi de licences permissives par Kyutai vise à encourager l’adoption et l’innovation à grande échelle, garantissant que les avantages de Moshi Chat sont accessibles à un public diversifié.

Comment utiliser Moshi Chat

Les utilisateurs peuvent et sont encouragés à essayez Moshi Chat en ligne via le site Web de Kyutai. Une fois là:

- Entrer votre Email

- Cliquez sur « Rejoindre la file d’attente »

- Commence à parler

Qu’il s’agisse de discuter de sujets du quotidien ou d’explorer des sujets plus complexes, les utilisateurs peuvent interagir naturellement avec Moshi Chat, en bénéficiant de ses capacités avancées de reconnaissance vocale et de synthèse.

Crédit de l’image en vedette: Kyutai/YouTube